作为一名专注于大数据处理与分布式计算的博主,我深知MapReduce作为一款经典的分布式计算框架,在海量数据处理领域所起的关键作用。本篇博客将结合我个人的面试经历,深入剖析MapReduce编程模型与优化策略,分享面试必备知识点,并通过代码示例进一步加深理解,助您在求职过程中自信应对与MapReduce相关的技术考察。

一、面试经验分享

在与MapReduce相关的面试中,我发现以下几个主题是面试官最常关注的:

-

MapReduce基本原理:能否清晰描述MapReduce的两阶段计算过程(Map、Reduce),以及如何通过Shuffle、Sort阶段实现数据分发与整合?

-

Hadoop MapReduce API:能否熟练使用Hadoop Java API编写Map、Reduce函数?如何设置JobConf、InputFormat、OutputFormat、Partitioner等关键组件?

-

MapReduce优化策略:如何根据业务需求选择合适的分区策略、Combiner、序列化方式以提升性能?如何避免数据倾斜、合理设置并行度?

-

应用场景与扩展:能否列举并解释MapReduce在日志分析、数据挖掘、机器学习等领域的应用?对MapReduce的扩展框架(如Spark、Tez)有哪些了解?

二、面试必备知识点详解

-

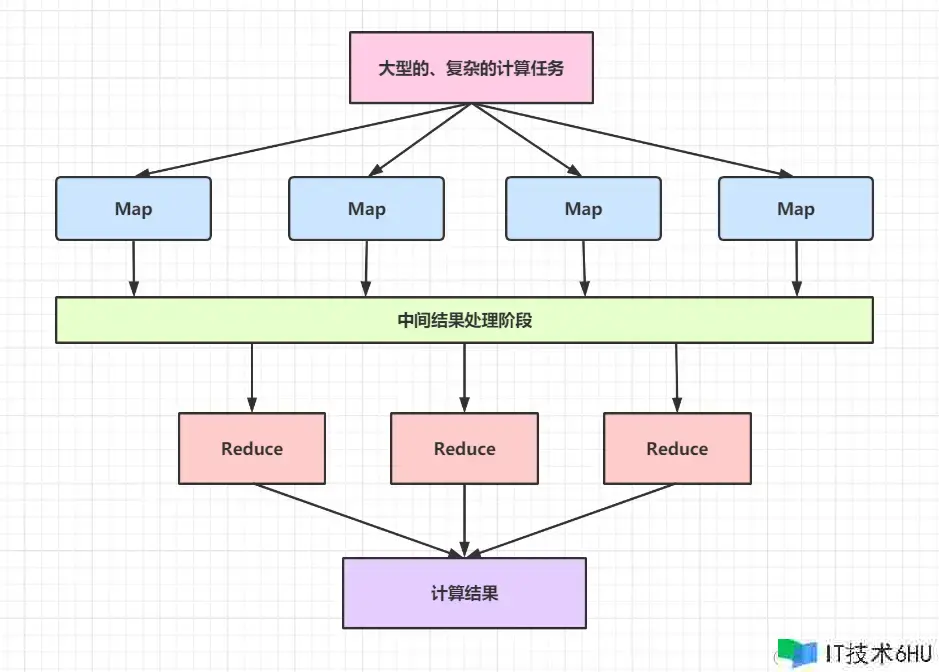

MapReduce基本原理 MapReduce是一种分布式计算模型,分为两个主要阶段:

-

Map阶段:输入数据被切分为若干独立的分片(Split),每个分片由一个Mapper任务处理。Mapper读取分片数据,对每条记录调用map()函数生成中间键值对(Intermediate Key-Value Pair)。

-

Reduce阶段:所有Mapper产生的相同键的键值对会被Shuffle阶段收集、排序,然后交给Reducer任务。Reducer读取排序后的键值对,对每组键调用reduce()函数进行聚合计算,输出最终结果。

-

import java.io.IOException;

import java.util.StringTokenizer;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class WordCount {

public static class TokenizerMapper

extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

public static class IntSumReducer

extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

-

Hadoop MapReduce API 编写Map、Reduce函数时,需实现Mapper、Reducer接口。通过Job对象设置JobConf、InputFormat、OutputFormat、Partitioner等关键组件。提交Job至Hadoop集群运行。

-

MapReduce优化策略 优化MapReduce性能,可考虑以下策略:

- 选择合适的分区策略:如HashPartitioner、TotalOrderPartitioner,确保数据分布均匀,减少Reducer间数据交换。

- 使用Combiner:在Map端进行局部聚合,减少网络传输与Reducer计算负担。

- 选择高效的序列化方式:如protobuf、Kryo,降低IO开销。

- 避免数据倾斜:识别并处理产生大量重复键的数据,使用自定义Partitioner、二次排序等方法。

- 合理设置并行度:根据硬件资源、数据规模调整Map、Reduce任务数量。

-

应用场景与扩展

MapReduce广泛应用于日志分析(如日志统计、异常检测)、数据挖掘(如频繁项集挖掘、聚类)、机器学习(如朴素贝叶斯分类、协同过滤)等领域。MapReduce的扩展框架如Spark、Tez引入了DAG执行模型、内存计算等特性,进一步提升了数据处理效率。

- 结语

深入理解MapReduce编程模型与优化策略,不仅有助于在面试中展现深厚的技术功底,更能为实际工作中处理大规模数据提供有效解决方案。希望本文的内容能帮助您系统梳理MapReduce相关知识,从容应对各类面试挑战。