标题: RT-2: Vision-Language-Action Models Transfer Web Knowledge to Robotic Control

论文: arxiv.org/pdf/2307.15…

导读

前作RT1的限制

-

RT1 是纯 low-level controller 的任务,训练的时候不会从互联网规模的丰富语义知识中受益

- 机器人控制数据成本高,数据集小(130k),模型泛化性能差

- 模型参数量少(35M),无法具有理解和推理能力

- PaLM-E 这些又是 high-level planning 的,训练的时候会从互联网规模的丰富语义知识中受益,但是本质上是充当状态机的角色,只是解释命令并将其解析为单个原语(例如拾取和放置对象)

思路

-

利用好PaLM-E 这种预训练的能力来增强泛化能力

- RT1 只是尽可能地拟合数据集的轨迹,泛化能力有限

- RT1+PaLM-E 可以找一些更符合人的行为的轨迹

-

即训练一个单一的模型同时具有以下两种能力:

- 将机器人的观察转换成动作的能力(RT1)

- 多模态大模型的推理能力(PaLM-E 等)

方法

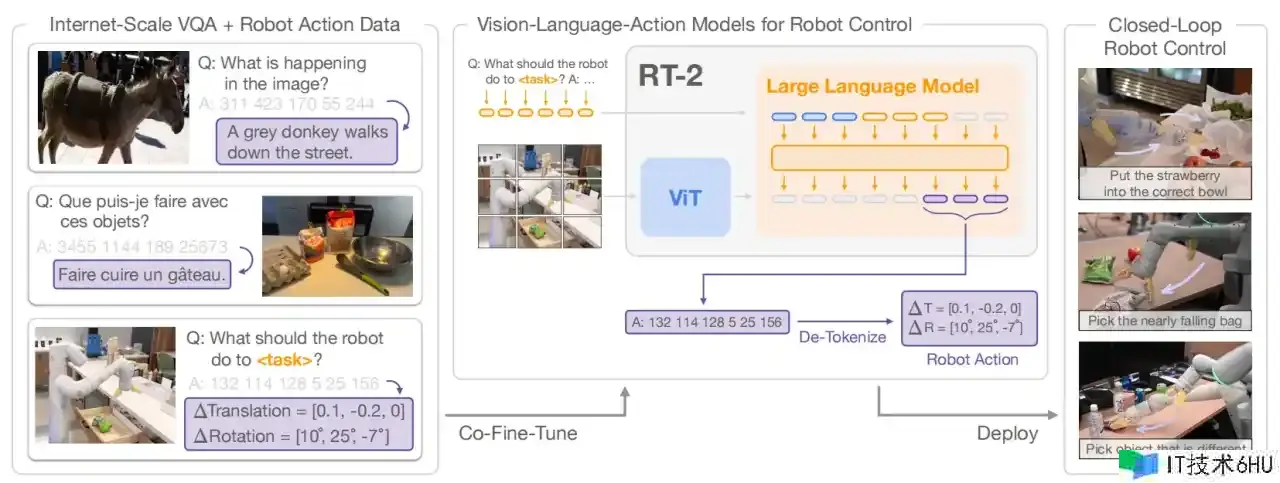

结合high-level planning 的VLM 和大规模网络数据,使用网络数据和机器人轨迹联合微调SOTA VLM 得到Vision-Language-Action Models,即将大型预训练VLM 的能力直接集成到机器人的low-level control中(或者反过来说),从而促进泛化并实现语义推理的涌现

Vision-Language-Action Models

Pre-Trained Vision-Language Models(high-level reasoning & planning)

-

利用预训练的视觉-语言大模型(PaLI-X(5B & 55B)和PaLM-E(12B)),输入图片序列和文本,产生一个 token序列

- **大规模数据集:**这些模型通常在包含数十亿图像-文本对的大规模数据集上进行预训练,这些数据集涵盖了多种语言和广泛的主题,从而使模型能够学习到丰富的视觉和语义知识。

- **多模态学习:**预训练视觉-语言模型通过同时处理视觉(图像)和文本(描述、问题等)输入,学习到跨模态的表示,这使得模型能够理解和生成与视觉内容相关的自然语言。

- **强大的基础能力:**通过在多样化的互联网数据上进行预训练,这些模型获得了强大的基础能力,包括对象识别、场景理解、属性抽取和复杂的推理任务。

- **迁移学习:**预训练模型的一个关键优势是它们可以通过迁移学习适应特定的下游任务。这意味着在预训练阶段学到的知识可以迁移到新的任务上,通常通过在特定任务的数据上进行微调来实现。

-

注意:

- PaLM-E 生成连续的是控制指令(high-level instruction),如上图所示,而不是 action,直接output action的工作比如Gato、VIMA、RT-1等

- 文章只是假定了存在一个low-level policy or planner(low-level controller),可以将这些instruction翻译成low-level actions

Robot-Action Fine-tuning

RT-2将预训练的视觉-语言模型(VLMs)进一步训练,使其能够直接控制机器人的动作。这个过程的目标是让模型学会将视觉输入和语言指令映射到具体的机器人动作上,从而实现对机器人的闭环控制。

- 为了使视觉语言模型能够控制机器人,就必须训练它们来输出动作(low-level controller 而不是high-level instruction)

- 既学习从state/observation -> action 的映射

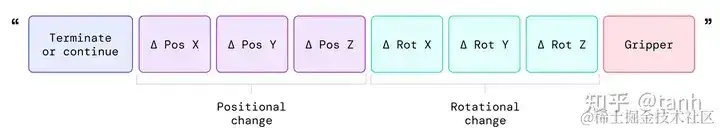

- 7个tokens表示一个动作,同 RT1

- 也能够从互联网的语言、视觉语言数据的大规模预训练中获益(Internet-scale training)

- 既学习从state/observation -> action 的映射

实现

- 标准的VLM模型可以输出完整的自然语言token; VLA模型需要输出能够被机器人执行的token,因此RT-2限制输出词汇表,仅采样可用的action token来实现对齐

- 即: VLM 输出 text token,但是机器人需要 action token

- action 来自于当前图像、语言命令和特定timestep的机器人动作

- 把 action 对齐成 action tokens(同 RT1),这些action tokens 在模型的训练集中被当作自然语言text toekn 一样处理。

- 即: VLM 输出 text token,但是机器人需要 action token

- 训练的时候,把 action token 对齐为 text token,变成multimodal sentences放到训练集中,微调(co-finetune) VLM 得到 VLA

- 在共同微调阶段,模型被训练来理解和生成这种结合了自然语言和动作标记的序列。模型学习如何根据视觉输入和语言指令生成正确的动作标记序列。

- 与原始web data一起 co-finetune 机器人数据,增加机器人数据集上的采样权重来平衡每个训练批次中robotics data和web data的比率。

- web data:1B图片文本对,包含109种语言

- 机器人数据和RT-1相同,130k条数据; “Pick Object”, “Move Object Near Object”, “Place Object Upright”, “Knock Object Over”, “Open Drawer”, “Close Drawer”, “Place Object into Receptacle”, and “Pick Object from Receptacle and place on the counter”

- 推理的时候,transformer自回归生成的tokens会被de-tokenize为action(每一个timestep的action,交由机器人去执行)

- 这种action tokens和文本tokens对齐的方式在机器人policy中利用了VLM的backbone和pretraining,一定程度转移了泛化性、语义理解、机器人控制方面的推理能力

实验

- 该工作中训练的最大模型有55B参数;

- 可以直接运行在用于实时机器人控制的GPU上;

- 这是到目前为止最大的模型,用于端到端的机器人控制;

- 模型部署在muti-TPU的云服务上,通过网络调用这个服务;

- 最大的模型,RT2-PaLI-X-55B,运行频率1-3Hz;

- 小点的模型,5B参数,可以运行5Hz;

实验目标

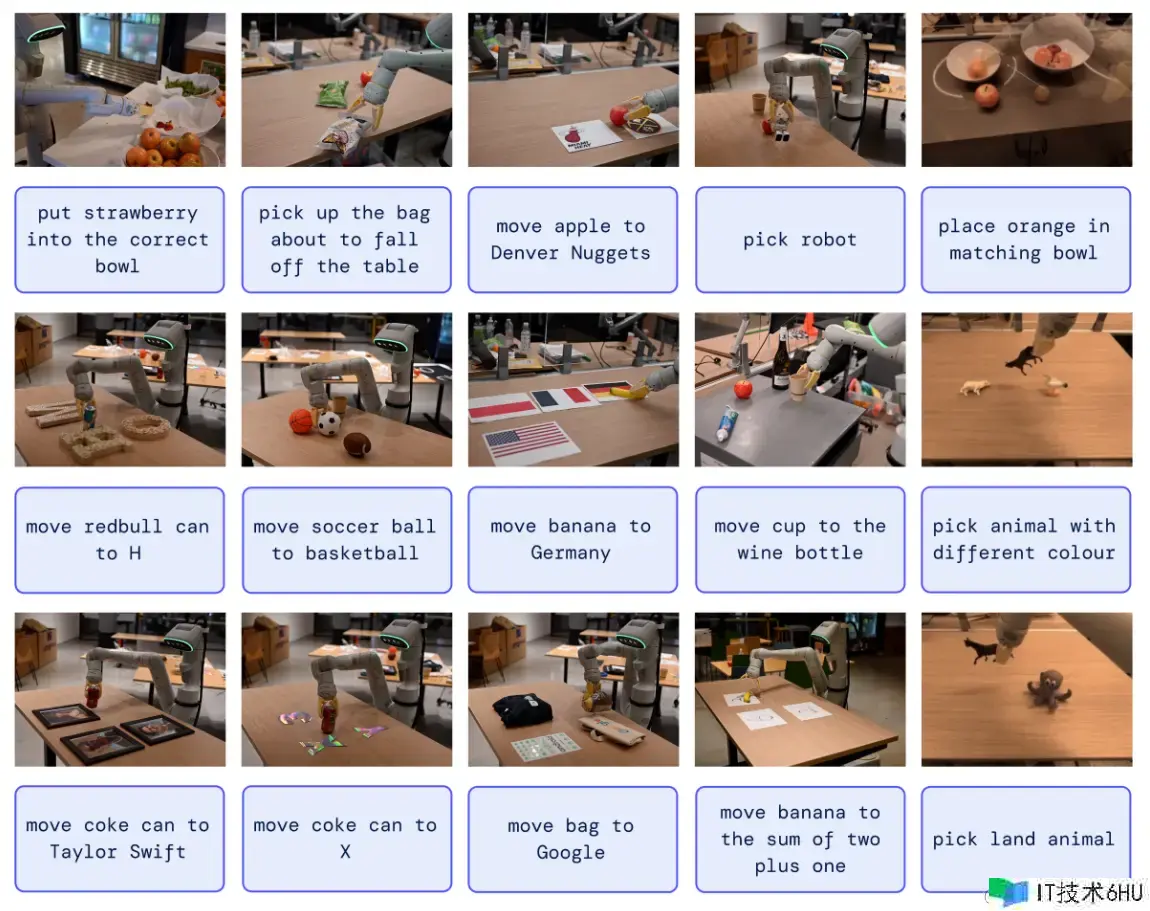

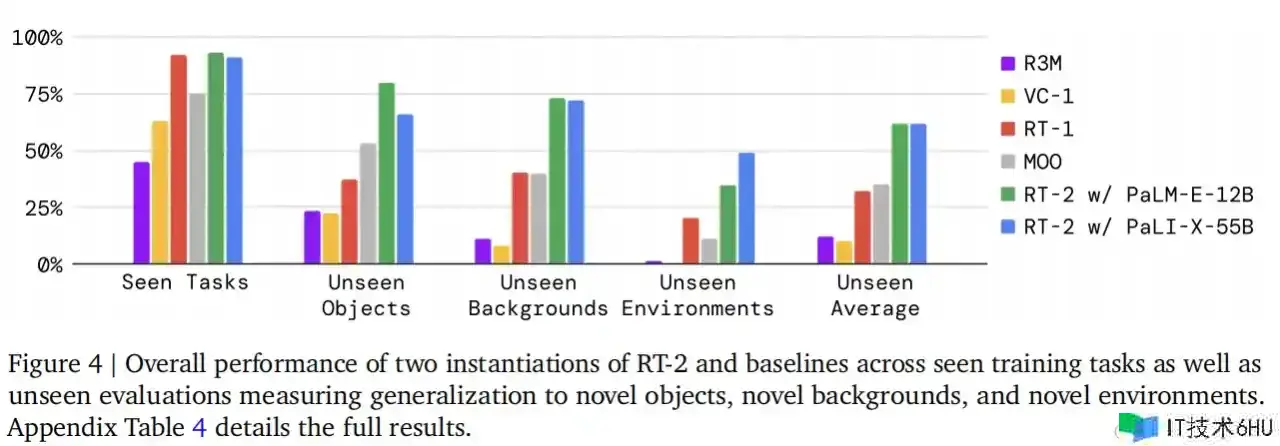

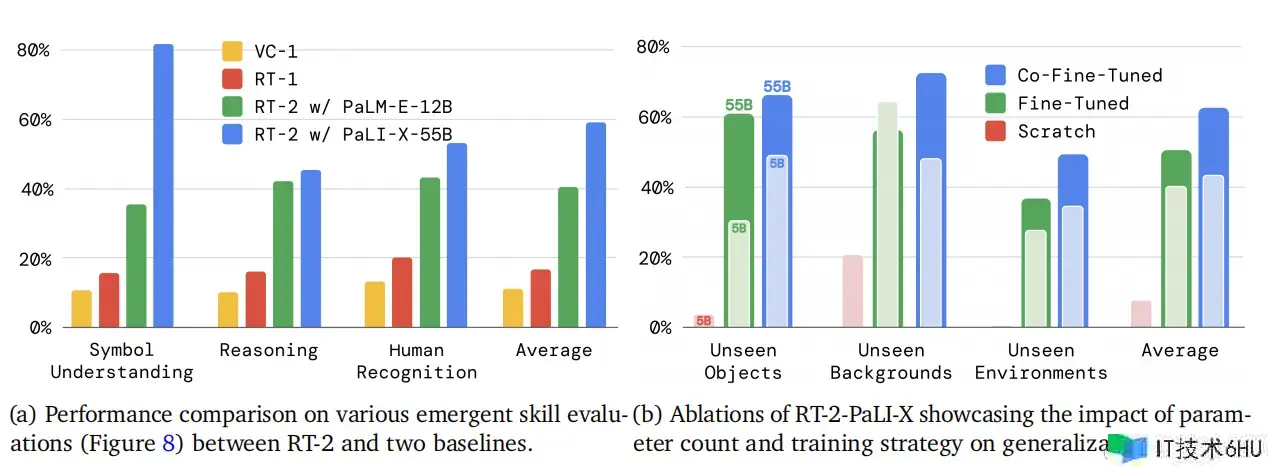

- 评估RT-2在已知任务上的表现。

- 测试RT-2对新对象、背景和环境的泛化能力。

- 观察和量化RT-2的新兴能力,包括语义理解和基本推理。

- 研究模型参数数量和其他设计决策对泛化能力的影响。

- 探索RT-2是否能够展示类似于视觉-语言模型的链式推理能力。

指标

- 在已知任务上,RT-2与其他基线模型相比没有显著差异。

- 在泛化到新对象、背景和环境的实验中,RT-2比基线模型表现出约2倍的改进。

- 在评估新兴能力的实验中,RT-2在符号理解、推理和人类识别任务上显著优于基线模型。

- 在模型大小和训练策略的消融实验中,发现更大的模型和共同微调策略能够带来更好的泛化性能。

总结

- 做的事情和大致的思路其实和以前的RT-1, VIMA等模型没啥区别,本质上就是一种将预训练的 PaLM-E 等预训练的 VLM 大模型如何加进这些模型中,不过从VLM finetune、action token对齐text token是比较新的点

- 限制:

- RT-2可以执行更加复杂的指令,这是因为从自然语言到动作能更容易被理解;但是不能泛化到新的行为上,因为网络上获取的数据只能帮助模型学会更多的视觉语义信息,无法学会新的行为

- 由于机器人数据集总体量级很少,并且无法搜集机器人没有做过的行为

- 可以从人类行为的视频中提取数据

- 无法实时推理:机器人控制模型需要模型能够实时推理,RT-2参数量太大,无法实时推理。后续工作的重点可以考虑模型量化和蒸馏,加快推理速度。

最后,诚邀对具身智能和多模态大模型等前沿AI技术感兴趣的同学加入CVHub官方知识星球,获取每日最新相关技术进展,共同探讨和推动人工智能领域的创新发展。在这里,您将有机会与同行交流心得,参与专业讨论,更有机会与行业专家进行深入互动,共同见证和塑造智能科技的未来。期待您的加入,让我们携手在人工智能的浪潮中乘风破浪!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。