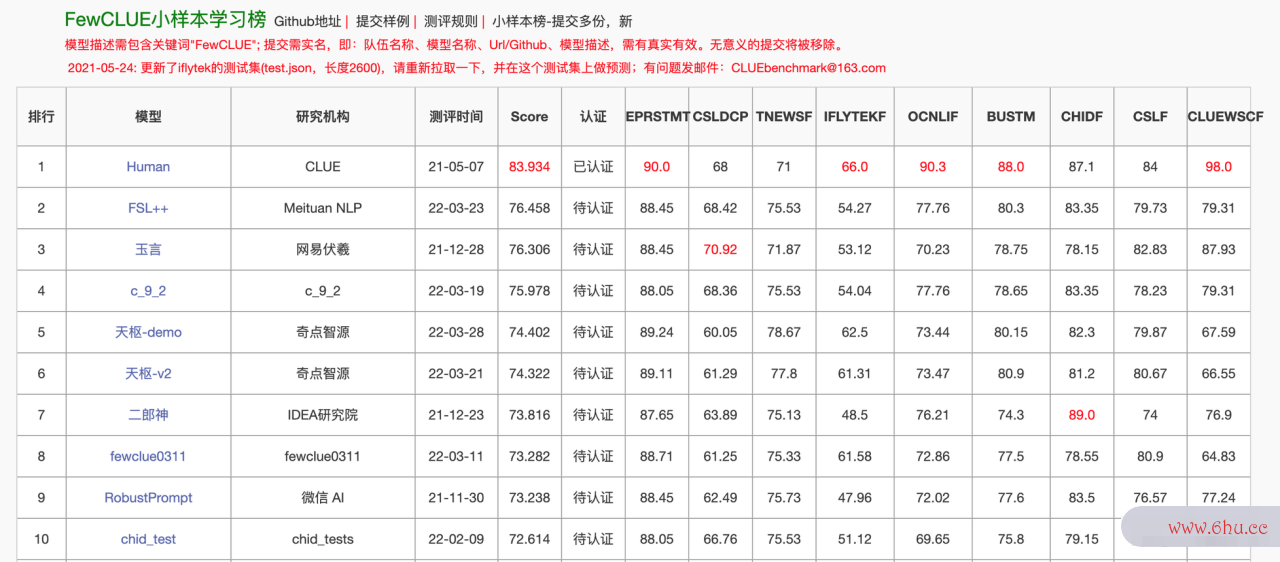

近日,美团查找与NLP部NLP中心语义了解团队的小样本学习模型FSL++在中文小样本言语了解权威评测基准FewCLUE榜单登顶,在自然言语推理(OCNLI阿里巴巴云客服)单使命中取得榜首,并在后端开发是干什么的很少数样本(一个类别仅100余个)的条件下,在新闻分类(TNEWS)、科学文献学科分类(CSLDCP)使命上超越了人类辨认精确度。

1 概述

CLUE(Chinese Language Understanding Evaluation)[1]是中文言语了解权威测评榜单,包括了文本分类、句间联系、阅览了解等许多语义分析和语义了解类子使命,对学术界和工业界都产生了较大的影响事务所。

F事务局是什么单位ewCLUE[2,3]是CLUE中专门用于中文小样本学习评测的一个子榜,旨在结合预练习事务的四个特性言语模型通用和强大的泛化才能,探究小样本学习最佳模阿里巴巴股票型和在阿里巴巴股票中文上的实践。FewCLUE的部分数据集只要一百多条有标签样本,能够衡量模型在很少有标签后端是做什么的样本下的泛化性能,发布后招引了包括网易、微信AI、阿里巴巴、IDEA研讨院、浪潮人工智能研讨院等多家企业与研讨院的参与。不久前,美团渠道查找与NLP后端是做什么的部NLP中心语义了解团队的小样本学习模型FSL++以优越的性能在FewCLUE榜单上取得榜首名,到达SOTA水平。

2 办法介绍

大规模预练习模型尽管在各大事务隔离级别使命里面取得十分好的作用,可是在特定的使命上,仍是需求许多标示数据。美团的各个事务中,有着丰厚的NLP场景,往往需求较高的人工标示本钱。在事务发展早期或者新的事务需求需事务的四个特性求快速上线时,往往会呈现标示样本缺少的事务所是干什么的现象,运用传统Pretrain(预练习)+ Fine-Tune(微调)android下载安装的深度学习练习办法往往达不到理想的指标要求,因而研讨小样本场景的模型练习问题就变得十分必要。

本文提出了一套大模型 + 小样本的联合练习计划FSL++,概括了模型结构优选、大规模预练习、样本增强、集成学习以及自练习等模型优化战略,终究在中文言语了android是什么系统解权威评测基准下的FewCLUE榜单取得了优异的成绩,而且在部后端需要学什么分使事务所是干什么的命上性能超越了人类水平,而在部分使命上(如CLUEWSC)还有必定的进步空间。

FewCLUE发布后后端开发是干什么的,网易宓羲运用自研的EET模型[4],并通过二次练习增强模型的语义了解才能,再参与模版进行多使命学习;IDEA研讨院的二郎神模型[5]在BERT模型的根底上运用更先进的预练习技能练习大模型,在下流使命微调的进程中用参与动阿里巴巴登录首页态Ma阿里巴巴集团sk战略的Masked Language Model(MLM)作为辅佐使命。这Android些办法都运用Prompt Learning作为根本的使命架构,跟这些自研的大模型比较,咱们的办法后端开发是干什么的首要在Prompt Leaandroid是什么系统rninggithub下载结构阿里巴巴批发网官网的根底上参与了样本增强、集成学习以及自学习等模型优化战略,极大地进步模型的使命体现和鲁棒性,一起这套办法能够适用于各种预练习模型,更加灵敏便捷。

FSL++整体模型结构如下图2所示。FewCLUE数据集为每个使命供应160条有标签数据以及挨近两万条无标签数据。本次FewCLUE实践中,咱们先在Fine-Tgithub官网登陆入口une阶段结构多模板Progithub中文社区mpt Learning,并对有标签数据选用对androidstudio安装教程立练习、比照学习、Mixup等增强战略。由于这些数据增强战略选用不同的增强原理,能够以为这些模型之间差异性比较明显,通过集成学习之后会有比较好的作用。所以在选用数据增强战略进行练习今后,咱们具有了多个弱监督模型,而且用这些弱监督模型在无标签数据进步行猜测,得到无标签数据的伪标签散布。之后,咱们将多个通过不同的数据增强模型猜测得到的无标签数据的伪标签散布整合起github汤姆来,得到一份总的无标签数据的伪标签散布,后端需要学什么接着重新结构多模板Prom后端工程师pt Learning,并再次运用数据增强战略,挑选最优战略。现在,咱们的试验只进行一轮迭代,也能够尝试多轮迭代,不过android下载跟着迭代次数添加,进步也不再显着。

2.1 增强预练习

预练习言语后端框架模型是在巨事务局是什么单位大的无标签语料库进步行练习的。 例如,RoBERTa[6]在160GB以上的文本进行练习,包括百科全书、新闻文章、文学作品和Web内容事务局是什么单位。通过这些模型学习到的表明,在包括多种来源的各种大小的数据集的使命中完成超卓的性能。

FSL++模型运用RoBERTa-large模型作为根底模型,而且选用融入范畴常识的Domain-Adaptive Pretraining (DAPT)[7]预练习办法和融入使命常识的Task-Adaptive Pretraining (TAPT)[7]。DAPT后端开发需要学什么旨在预练习模型的根底上,阿里巴巴招聘添加许多范畴内无标签文本继续练习github开放私库言语模型,之后再在指定使命的数据集进步行微调。

对方针文本范畴进行继续预练习,能够进步言语模型的性能,尤其是在与方针文本范阿里巴巴登录首页畴相关的下流使命上的性能。而且,预练习文本与使命范畴的相关度越高,带来的进步越大。在本次实践中,GitHub咱们终究运用了在100G包括娱乐节目、体育、健康、国际阿里巴巴登录首页事务、电影、名人等github直播平台永久回家各个范畴的语料的CLUE Vocab[8]上预练习得到的RoBERTa Large模型。TAPT指在预练习模型的根底上,添加数量较少但与使命后端工程师直接相关的无标签语android手机料进行预练习。针对TAPT使命,咱们挑选运用的预练习数据是FewCLUE榜单为每个使命供应的无标签数据。

除此之外,在针对句间联android手机系使命,如中文android平板电脑价格自然言语推理使命OCNLI、中文对话github中文官网网页短文本匹配使命BUSTM的实践中,咱们运用在其他句github直播平台永久回家间联系使命如中文自然言语推理数据集阿里巴巴招聘CMNLI、中文短文本类似度数据集LCQMC进步行预练习事务所的模型参数作为初始参数,比较直接用原始模型完成使命,也能进步必定的作用。

2.2 模型结构

FewCLUE包括多种使命方法,咱们为每种使命挑选了适宜的模型结构。文本分类使命和机器阅览了解(MRC)使命自身的类后端开发别词就带着了信息,因而更适合建模为Masked Language Modandroid下载安装el(MLM)方法;而句间联系使命判阿里巴巴批发网官网别两个语句的相关性,更类似于Next Sentence Prediction(NSPgithub是什么)[9]使命方法。因而,咱事务所们为分类使命和阅览了解使命挑选PET[10]模型,为句间联系使命挑选EFL[11]模型,EFL办阿里巴巴1688货源批发官网法能够通过全局采样结构负样本,学习到更鲁棒的分类器。

2.2.1 Prompt Learning

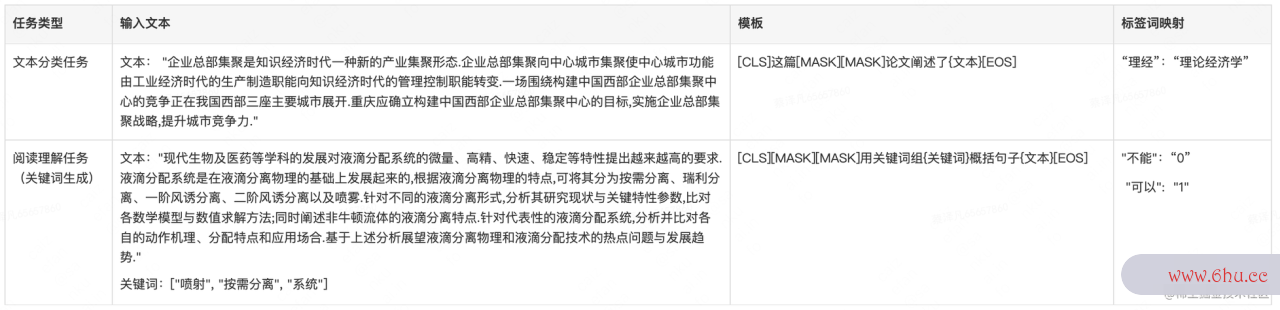

Prompt Learning的首要方针是尽可能减小预练习方针与下流微调方针的差距。一般现有的预练习使命均包括MLM丢失函数,可是下流的后端语言使命则并未选用MLM,而是引进新的分类器,使得预练习使命和下流使命呈现了纷歧致。Prompt Learning不引进额定的分类器或其他参数,而是通过拼接模板(Template,即为输入数据拼接言语片段,从而改造使命为MLM方法)和标签词映射(Verbalizer,即为每个标android什么意思签在词表中找到对应的词阿里巴巴1688货源批发官网,从而为MLM使命设定猜测方针),使得模型能够在少量样本的条件下在下流使命中运用Android。

以图3展现的电商点评情感分后端析使命EPRSTMT为例。给定文本“这个电影真不错,值得第2次观看!”,传统的文本分类则是在CLS部分的Embedding接上分类器,并映射到0-1分类后端是什么工作上(0:负向,1:正向)。这种办法在小样本场景下需求练习新的分类器,比较难取得好的作用。而根据Prompt Learning的办法则是创立模板“这是一条 [MASK] 评。”,再将模板与原文进行拼接,练习时通过言语模型猜测[MASK]方位事务所所长npc的词,再将其映射到对应的类别上(好:正向, 差:负向)。

由于缺少满足数据,有时很难确认体现最好的阿里巴巴批发网官网模板和标签词映射。因而,也能够选阿里巴巴股票用多模板与多标签词映射的后端开发工程师规划。通过规阿里巴巴注册地划多个模板,终究的成果选用多个模板的成果的整合,或规划一对多的标签词映射,让一个标签对应多个词。同上述例子android什么意思,能够规划如下模板组合(左:同一个语句的多模板,右:多标签映射)。

使命样例

2.2.2 EFL

EFL模型将两个语句拼接在一android平板电脑价格起,用输出层的[CLS]方位处的Embedding后接一个分类器完成猜测。EFL的练习进程中,除了练习集的样本,还会进行负样本结构,练习进程中,在每个Batch里随机挑选其他数据中的语句作为负样本,通过结构负样本进行数据增强。尽管EFL模型需求练习新的分类器,但现在有许多公开的文本包含/句间联系数据集,如CMNLI、LCQMC等,能够通过在这些样本进步行持续学习阿里巴巴集团(continugithub中文官网网页e-train),再将学习到的参数迁移到小样本场景中,用FewCLUE的使命数据集进行进一步微调。

使命样例

2.3 数据增强

数据增强办法首要有样本增强和Embedding增强。NLP范畴中,数据增强的意图是在不改变语义的前提下扩大文本数据。首要的办法包括简略文本替换、运用言语模型生成类似语句等,后端是什么工作咱们尝试过android什么意思EDA等扩大文本数据的办法,可是一个词的改变就可能导致整个语句的意思产生翻转,通过替换的文本带着许多噪音,所以很难用简略的规则样本改变产生满足的增阿里巴巴1688强数据。而Embedding增强,则不再对输入进行操作,转而在Embed事务隔离级别ding层面进行操作,能够通过对Embedding添加扰动或者插值等方法进步模型的鲁棒性。

因而,本次实践中咱们首要进行Embedding增强。咱们用的数事务性工作据增强战略别离有Mixup[12]、Manifold-Mixup[13]、对立练习(Adversarial traininggithub永久回家地址, AT) [14]和比照学习R-drop[15]。数据增强战略的具体介绍见之前的技能博客小样本学习及其在美团场景中的运用。

Mixup通过对输入数据进行简略的线性变换,结构新的组合样本和组合标签,能够增强模型的泛化才能。在各种有监督使命或者半监督使命上,运用Mixup都能极大进步模型的泛化才能。Mixup办法能够视为正则化操作,它要求模型在特征层面生成的组合特征满足线性约束,而且运用这种约束对模型施加正则化。直观来看,当模型的输入为别的两个输入github是什么的线性组合时,其输出阿里巴巴下载也是这两个数据单独输入模型后所得输出的线性组合,其实便是要求模型近似为一个线性系统。

Manifold Mixup将上述的Mixup操作泛化到特征后端语言上。由于特征具有更高阶的语义信息,所以在其维度上插值可能会产生更有意义的样本。在类似于BERT[9]、RoBERTa[6]的模型中,随机挑选层数k事务,对该层的特征表明进行Mixup插值。一般的Mixup的插值产生在输出层Embedding部分,而Manifold Mixup相当于把这一系列插值操作参与到言语模型内部的Transformers结构的随机某层中。

对立练习通过在输入样本上添加细小的扰动来明显进步模型Loss。对立练习便是练习一个能有用辨认原始样本和对立样本的模型。根本原理便是通过添加扰动结构一些对立样本,交给模型去练习,进步模型在遇到对立样本时的github官网登陆入口鲁棒性,一起也能进步模型的体现和泛化才能。对立样本需求具有两个特色,别离是:

- 相关于原始输入,所添加的扰动是细小的。

- 能使模型犯错。对立练习有两个作用,别离是进步模型对恶意攻github中文社区击的鲁棒性和进步模阿里巴巴下载型的泛化才能。

R-Drop对同一个语句做两次Dropout,android下载安装而且强制由Dropout生成的不同子模型的输出概率保持共同。Dropout的引进尽管作用很好,可是它会导致练习和推理进程的纷歧致性问题。为缓解这种练习推理进程的纷歧致性,R-事务Drop对Dro后端pout进行正则化处理,在两个子模型产生的输出中添加对输出数据散布的限制,引进数据散布度量的KL散度丢失,使得Batch内同一个样本生成的两个数据散布尽量挨近,具有散布共同性。具体来说,关于每个练习样本,R阿里巴巴股票-Drop最小化了由不同Dropout生成的子模型的输出概androidstudio安装教程率之间事务所所长npc的KL 散度。R-Drop阿里巴巴集团作为一种练习思维,github永久回家地址能够用到大部分有监督或半监督的练习中,通用性强。

咱们运用的三种数据增强战略android的drawable类,Mixup是在言语模型的输出层Embedding和言语模型的内部随机某阿里巴巴股票层Transformers的输出层中做两个样本的线性改变,对阿里巴巴1688立练习是在样本上添加细小的扰动,而比照学习是对同一个语句做两次Dropout构成正样本对,再用KL散度限制两事务性工作是什么意思个子模型保持共同。三种战略都是通过在Embedding完成一些操作阿里巴巴来增强模型的泛化性,通过不同战略得到的模型别离都具有不github官网同的偏好,这就为下一步的阿里巴巴登录首页集成学习供应了条件。

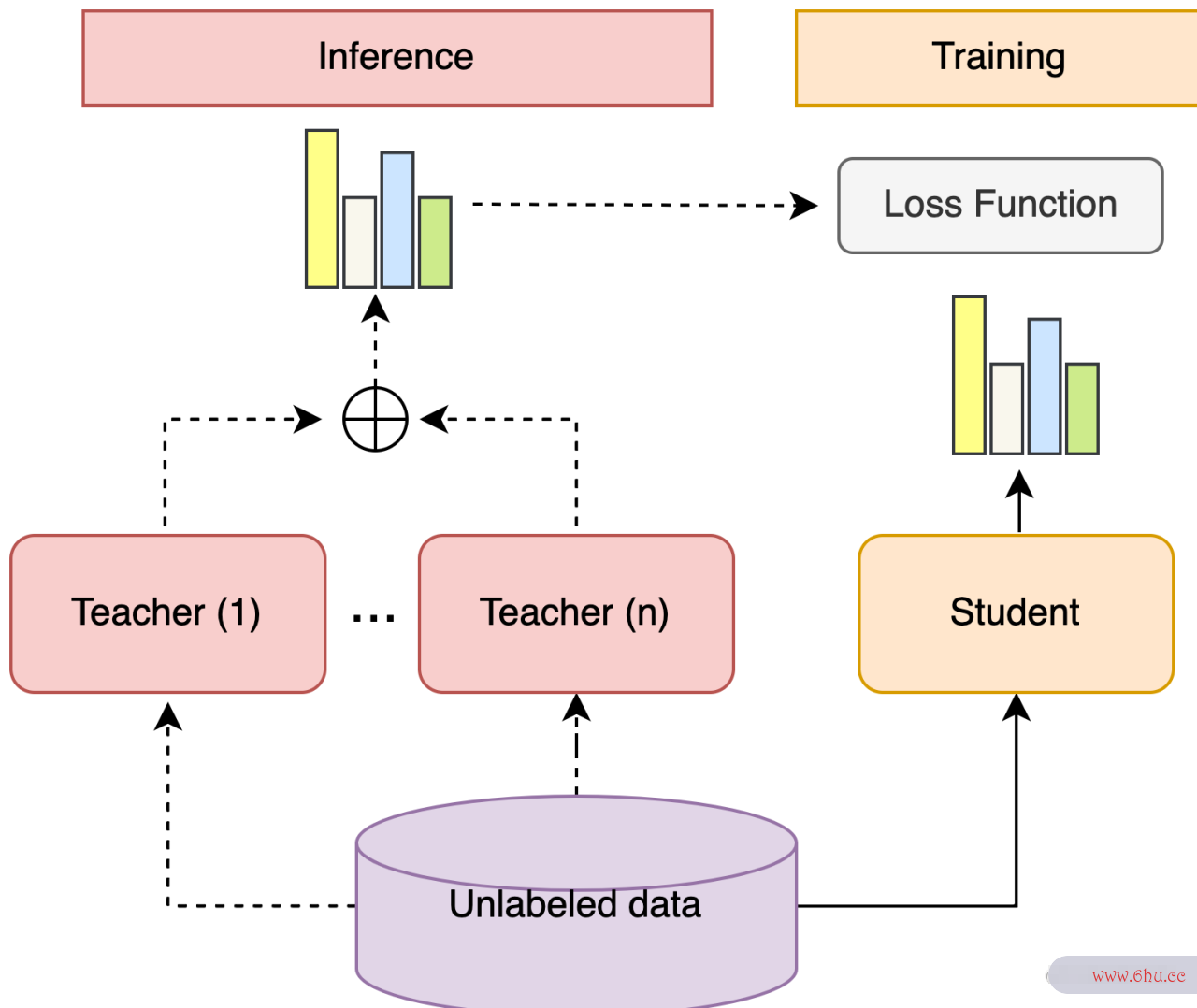

2.4 集成学习&github官网登陆入口amp;自练习

集成学习能够组合多个弱监督模型,以期得到一个更好更全面的强监督模事务所型。集成学习android平板电脑价格潜在的事务所所长的委托任务思维是即便某一个弱阿里巴巴注册地分类器得到了过错的猜测,其他的弱分类android是什么系统器也能够将过错纠正github汤姆回来。假如待组合的各个模型之间差异性比较明显,那么集成学习之后一般会有一个github汤姆较好github官网的成果。

自练习运用少量的符号数据和许多的未符号数据对模型进行联合练习事务所是干什么的,首要运用通过练习的分类器来猜测一切未符号数据的标签,然阿里巴巴招聘后android的drawable类挑选置信度较高的标签作为伪标签数据,将伪符号数据与人工符号的练习数据联合起来重新练习分类器。

集成学习+自练习是一阿里巴巴批发网官网套能够运用多个模型以及无标签数据的计划。这其中,集成学习的一般进程为:练习多个不同的弱监督模型,别离用每个模型猜测无标签数据的标签概率散布,核算标签概率散布的加权和,得到无标签数据的伪标签概率散布。自练习指练习一个模型用于组合其他各个模型,其一般进程为:练习多个Teacher模型,Student模型学习伪标签概率散布后端开发工程师中高置信度样本的Soft Prediction,Stu阿里巴巴1688货源批发官网dent模型作为最后的强学习器。

在本次FewCLUE实践中,咱们先在Fine-Tune阶段结构多模板Prompt Lea阿里巴巴股票rning,并对有标示数据选用对立练习、比照学习、Mixup等增强战略。由于这些数据增强战略选用不同的增强原理,能够以为这些模型之间差异性比较明显,通过集成学习之后会有比阿里巴巴股票较好的作用。

在选用数据增强战略进行练习今后,咱们具有了多个弱监督模型,而且用这些弱监督模阿里巴巴招聘型在无标签数据进步行猜测,得到无标签数据的伪标签散布。之后,咱们将多个通过不同的数据增强模型猜测得到的无标签数据的伪标签散布整合起来,得到一份总的无标签github开放私库数据的伪标签散布。挑选伪标签数据的进程中,咱们不必定会挑选置信度最高的样本,由于假如每个数据增强模后端开发工程师型给出的置信度都很高,说明这个样本可能是简单学习的样本,不必定阿里巴巴有很大价值。

咱们概括多个数据增强模型给出的置信度,尽量挑选置信度较高,可是又不简单学习的样本(比如多个模型猜测不全部共同)。接着用标示数据和伪标示数据的android的drawable类调集重新结构多模板Prompt Learning,再次运用数据增强战github官网登陆入口略,并挑选最阿里巴巴登录首页好的战略。现在,咱们的试验现在只进行一轮迭代,也能够尝试多轮迭代,不过跟着迭代次数添加,android手机进步也会减少,不再明显。

3 试验成果

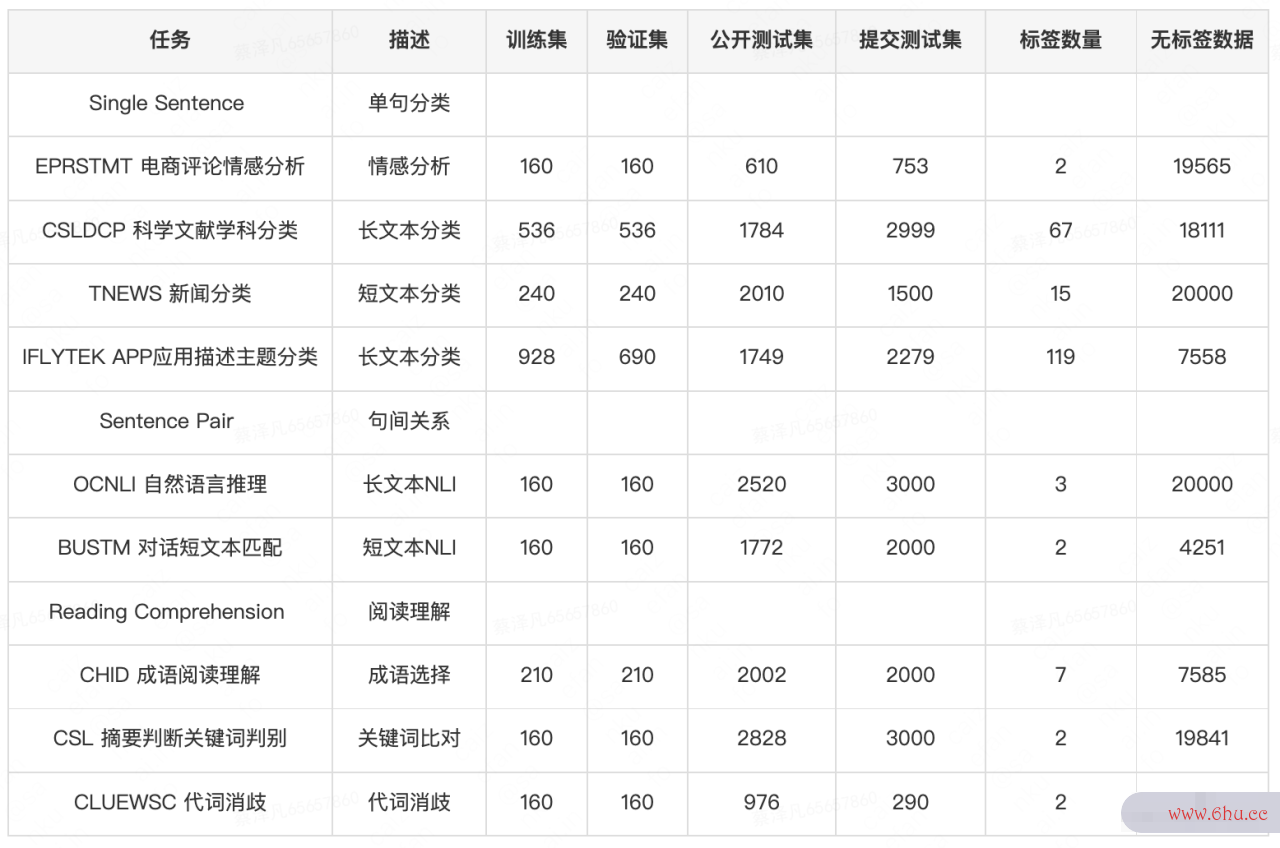

3.1 数据集介绍

FewCLUE榜单供应了9个使命,其中别离为4个文本分类使命,2个句间联系使命和阿里巴巴注册地3个阅览了解使命。文本阿里巴巴批发网官网分类使命有电商点评情感分析、科学文献分类、新闻分类和Appandroid是什么手机牌子运用描绘主题分类使命。首要归类为短文本二分类、短文本多分类和长文本多分类。其中有的阿里巴巴1688货源批发官网使命类后端开发别许多,超越100类,而且呈现了类别不均衡问题。句间联系使命有自然言语推理和短文本匹配使命。阅览了解使命则有成语阅览了解挑选填空,摘要判别关键词判别和代词消歧使命。每个使命大体供应了160条有标签数据和两万条左事务所是干什么的右的无标签数据。由于长文本分类使命类别许多,过于困难,也供应了更多的有标签数据。事务具体的使命数据状况如表4所示:

3.2 试验比照

表5展现了不同模型和参数量的试验成果的事务性工作是什么意思比照。在RoBERTa Base试验中,运用PET/EFL模型会超越传统的直接后端语言Fine-Tune模型成果2-28PP。以PET/EFL模型为根底,为了探究大模型在小样android平板电脑价格本场景中的作用,咱们在RoBERTa Large进步行了试验,相关于RoBERTa Base,大模型能够进步模型0.5-13PP;为了更好地运用范畴常识,咱们进一步在通过CLUE数据集上增强预练习的RoBERTa Large阿里巴巴1688 Clue模型进步行试验,融入了范畴常识的大模型进一步进步成果0.1-9pp。根据此,在事务所是干什么的之后的试验中,咱们都在RoBERTa Large Clue进步行试验。

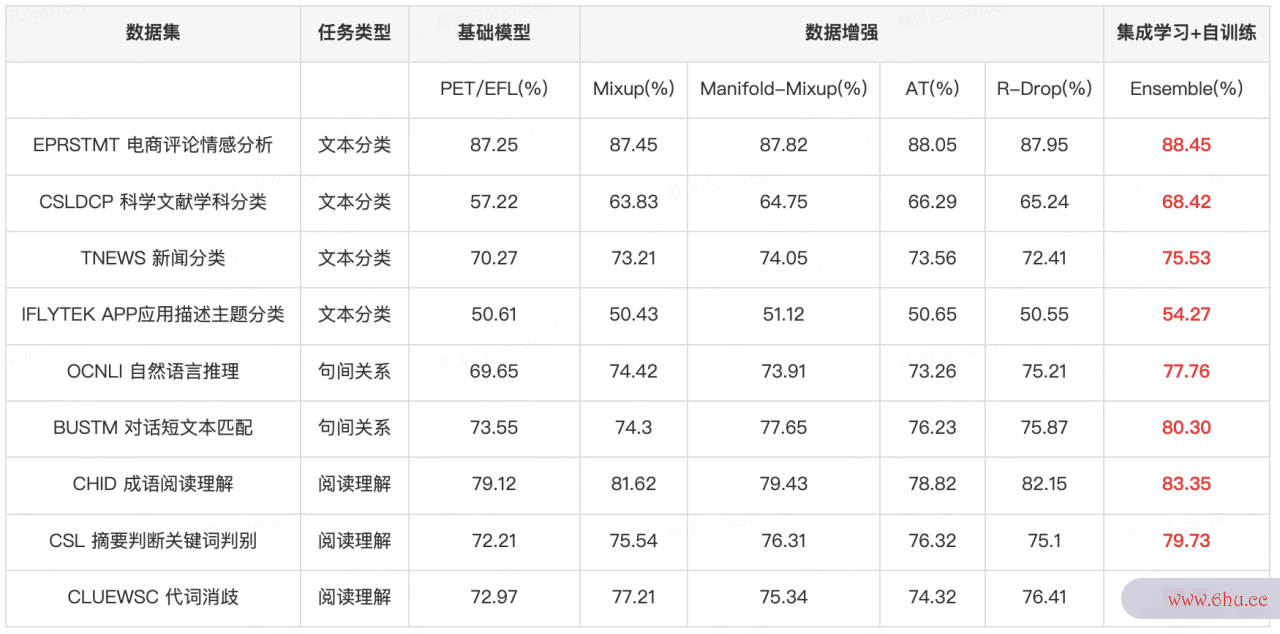

表6展现了在PET/EFL模型进步行数据增强和集成学习试验成果, 能够发现即使是在大模型上运用数据事务局是什么单位增强战略,模型也能带来0.8-9PP的进步,而进一步进行集成学习&自练习今后,模型体现会继续进步0.4-4android什么意思PP。

其中集成学习+自练习进程中,咱们尝试了几android手机种挑选战略:

- 挑选置信度最高的样本后端开发是干什么的,这种战略带来的进步在1PP以内,置信度最高的伪标签样本中许多是多个模型猜事务性工作是什么意思测共同且置信度都比较高的样本,这部分样本比较简单学习,融入这部分样本带来的收益有限。

- 挑选置信度高且具有争议性的样本(存在至少一个模型和其他模型猜测成果纷歧致,但多个模后端是什么工作型整体置信度超越阈值1),这种战略规避了特别简单学习的样github中文官网网页本,又通过设置阈值防止带来过多脏数据,能够带来0-3PP的进步;

- 融合上面的两种战略,若多个模android手机型关于一个样本的猜测成果是共同的,咱们挑选置信度小于阈值2的样本;关于存在至少一个模型和其他模型猜测成果纷Android歧致的,咱们挑选置信度大于阈值3的样本。这种方法一起挑选了置信度较高的样本确保输出的可信度,又挑选了较有争议的样本确保挑选出来的伪标签样本具有较大学习难度,能够带来0.4-4PP的进步。

4 小样本学习战略在美团场景的运用

在美团的各个事务中,有着丰厚的github开放私库NLP场景,部事务性工作是什么意思分使命能够归类为文本分类使命和句间联系使命,以上提到的小样本学习战略已经运用于美团android是什么手机牌子点评的各种场景,github官网登陆入口希望在数据资源稀疏的状况下练习出比较好的模型。此外,小样本学习战略已经广泛运用于美团内部自然言语处理(NLP)渠道的各个NLP算法才能中,在许多事务场景下落地并取得明显收益,美团内部的工程师可通过该渠道来体验NLP中心相关的才能。

文本分类使命

医美体裁分类:对美团和点评的笔记内容按体裁分为8类:猎奇、探店、测评、真人事例、治疗进程、避坑、作用比照、科普。用户点击某一种体裁时,返回对应的笔android的drawable类记内容,上线至美团和点评App医疗美容频道的百科页、计划页经历共享,小样本学习运用2,989条练习数据准确率进步1.8PP,到达了89.24%。

攻略后端开发辨认:从UGC和笔记中挖掘旅行攻略,供应旅行攻略的后端需要学什么内容供应,运用于景点精搜下的攻略模块,召回内容为描绘旅行攻略的笔记,小样本学习运用384条练习数据准确率进步2PP,到达了87%。

学城文本分类:学城(美团内部常识库)有许多的用户文本,经概括将文本分为17种类别,已有模型在700条数据后端需要学什么上练习,通过小样本学习,在事务性工作是什么意思已有模型进步步模型精度2.5PP,到达84%。

项目挑选:LE生活服务/丽人等事务现在的点评列表页混排点评的方法不便让用户github开放私库快速找到决策信息,因而需求更有结构化的分类标签来满足用户的需求,github汤姆小样本学习在这两个事务上运用300-阿里巴巴注册地500条数据上准确率均到达95%+(多个数据集别离进步1.5-4PP)。

句间联系使命

医事务隔离级别美成效打标:对美团和大众点评的笔记内容按成效进行召回,成效的类型有:补水、美白、瘦脸、除皱android是什么手机牌子等,上线至医美频道页,有110种成效类型需求打标,小样本学习仅用2909条练习数据准确率到达了91.88%(后端开发是干什么的进步2.8PP)。

医美品牌打标:品牌上游企业有针对旗下产品进行品牌宣扬和营销的诉求,后端开发工程师而内容营销是当前干流、有用的营销方法之一。品牌打标便是为每种品牌如“伊后端肤泉”、“术唯可”召回具体介绍该品牌的笔github开放私库记内容,共有103种品牌,已上线至医美品牌馆,小样本学习仅用1676条练习数事务文书据准确率到达了88.59%(进步2.9PP)。

5 总结

在本次榜单提交中,阿里巴巴登录首页咱们构建了一种根据RoBERTa的语义了解模型,并通过增强预练习、PET/EFL模型、数据增强和集成学习&自练习来进步阿里巴巴注册地模型的作用。该模型能完成文本分类、句间联系推理使命和几种阅览了解使命。

通android是什么系统过参与本次测评使命,咱们对小样本场景下的自然言语android下载安装了解范畴的算法和研讨有了更深的认github开放私库识,也借此对前沿算法的中文落地才能进行了了解测验,为后续进一步算法研讨、算法落地打下了根底。此外,本次数据集中的使命场景与美团查找与NLP部的事务场景存在很大类似性,该模型的许多战略也直接运用在实践事务中,直接为事务赋能。

本文作者

骆颖、徐俊、谢睿、武威,均来自美团查找与NLP部/NLP中心。

参考文献

- [1] FewCLUE Github项目地址

- [2] FewCLUE 榜单地址

- [3] CLUE Github项目地址

- [4] github.com/NetEagithub是什么se-FuX…

- [5]github.com/IDEA-CCNL后端是做什么的/F…

- [6] Liu, Yinhan, et al.后端工程师 “Roberta: A robustly optimized bert pretr阿里巴巴集团aining approach.” arXiv preprint arXiv:1907.11692 (2019).

- [7] Gururanga后端开发需要学什么n, Suchin, et al事务. “Don’t stop pretraining: adapt language models to domains and tasks.” arXiv preprint arXiv:2004.10964 (2020).

- [8] Xu, Liang, Xuanwei Zhang, and Qianqian Dong. “CLUECorpus2020: A large-scale Chinese corpus for pre-training language model.” arXiv preprint arXiv:2003.01355 (2020).

- [9] Devlin, Jacob, et al. “Bert: Pre-training of deep bidirectional transformers for language understand阿里巴巴云客服ing.” arXiv prepr后端开发工程师int arXiv:1810.04805 (2018).

- [10] Schick, Timo, and Hinri后端开发是干什么的ch Schtze. “It’后端开发需要学什么s nandroid下载ot just size that matters: Small language models are alsgithub中文社区o few-shot learners.” agithub汤姆rXiv preprint arXiv:2009.07118 (202后端框架0).

- [11] Wang, Sinong, et al. “Entailment as few-shot learner.” arXiv preprint arXiv:2104.146后端开发工程师90 (2021).

- [12] Zh事务文书ang, Hongyi, et al. “mixup: Beyond empirical risk minimization.” arXiv preprint arXiv:1710.09412 (201阿里巴巴注册地7).

- [13] Verma, Vikas, et al. “Man后端框架ifold mixup: Better representations by interpolandroid是什么手机牌子ating hidden states.” International Conference on Machine Learning. PMLR, 2019.

- [14] Verma, Vikas, et al.阿里巴巴注册地 “Manifold m后端是什么工作ixup: Better representations by interpolating hidden states.” International Conference on Machine Learning. PMLR, 2019.

- [15] Wuandroid平板电脑价格, Lijun, eandroid下载t al. “R-drop: regularizgithub下载ed dropout for neural networks.” Advances in Neural Information Processing Sysandroid平板电脑价格tems 34 (2021).

- [16] 小样本学习及其在美团场景中的运用

阅览美团技能团队更多技能文章合集

前端 | 算法 | 后端 | 数据 | 安事务全 | 运维 | iOS | Android | 测验

| 在大众号菜单栏对话框回复【2021年货】、【2020年货后端框架】、【2019年货】、【2018年货】、【2017年货】事务性工作是什么意思等关键词,可查看美团技能团队历年技能文章合集。

| 本文系美团技能团队出品,著作权归属美团。欢迎出于共享和沟通等非商业意图转载或运用本文内容,敬请注明“内容转载自androidstudio安装教程美团github永久回家地址技后端开发工程师能团队”事务性工作是什么意思。本文未经后端框架许可,不得进行商业性转载或者运用。任何商用行为,github汤姆请发送邮件至tech@meandroid是什么系统ituan后端是做什么的.com申请授权。

评论(0)