一起养成写作习惯!这是我参与「日新计划 4 月更文挑战」的第20天,点击查看活动详情。

轻量级神经网络——shuffleNet

shuffleNet2

通卷积神经网络过对shuffleNet1的讲解,相信大家已经对分组卷积和通道重排神经网络控制有了清晰的认识。那么shuffleNet2相较卷积层于shu架构是什么意思ffleNet1有什么不同卷积核之处呢?下面就让我们一起来学习卷积神经网络的工作原理学习✈✈✈

在shuffleNet2论文开始,文章就指出了一个观点:使用广泛使用的FLOPs来度量一个网络的运算量是不全面的,也通过实验表明即使具有相同的FLO效率符号Ps,也会有不同的速度,如下图所示。【图中横坐标表示FLPOs的大小,纵坐标表示速度】

使用间接测量网络速度的FLOPs不准确,是因为还有别的因素影响着网络的速度。下图展示了在网络整个运行时间被分解为不同的部分架构是什么意思。我们注意到FLOPs度量只考虑了卷积部分。虽然这部分操作耗费的时间最多,但其他操作包括数据I/O、数据转移和元素操作(AddTensor、ReLU等)也会占用大量的时间。因此,FLOPs对实际卷积核运行时的估计不够精确。

卷积神经网络的工作原理 基于这一观神经网络引擎察,论文从几个不同的方面神经网络的基本原理对运行时(或速度)进行了详细的分析,并得出了高效的网络架构设计的4个实用指南。

G1:输入输出通道数相同,MAC最小✨✨✨

MAC为内存访问量,不会计算的效率的拼音请移步神经网络参数量、计算量(FLOP卷积的物理意义S)、内存访问量(AMC)计算详解。由于现代网络通常采用深度可分离卷积,1×1的逐点卷积占了很大一部分的运算量。论文中以1×1的卷积核为例,假设输入通道数量为架构师C1,输出通道数量为C2,特征图大小为效率是什么意思hxw,则1×1的卷积的FLOPs=hwC1C2。我们还可以通过不等式进行相关推导,如下图:当C1=C2时,MAC取最小值。卷积运算

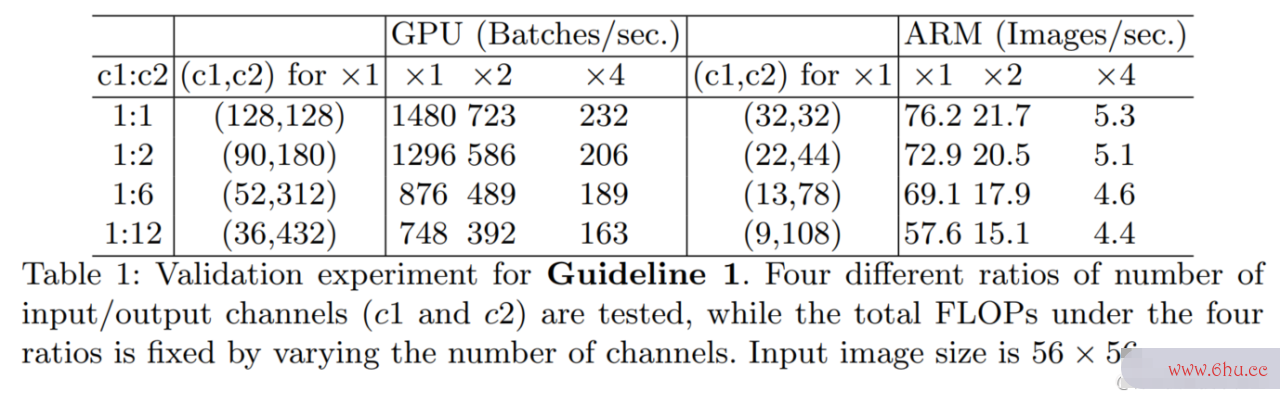

论文中不仅给出了证明,同时也做了一系列的对照实验来证明,下表为不同输入输出通道比(C1:C2)下GPU和CPU下网络的处理速度,可以发现当C1=C2时,网络处理的速度最快。【注意:这里要控制FLOPs不变,因此不仅调节C1、C2的比例,效率是什么意思还会将他们的通道数进行一定的改变以达到FL架构工程师OPs不变】

G2:分组数过大的分组卷积会增加MA卷积层C✨✨✨

首先需要知道分组卷积的计算量和参数量都是普通卷积的1神经网络算法三大类gfrac{1}{g}(假设分组的组数为g)。接下来我们仍然可以做一些算效率计算公式术推导证明结论。由下图可知,MAC和分组数成正相关,即分组卷积的分组数越大,MAC越大。

同样的,论文中对这部分也做架构了一系列的对照实验,下表为不神经网络预测同分组g下GPU和CPU下网络的处理速度,可以发现分组数越大,网络的处理速度越慢。【注意:同样需要保持FLOPs不架构工程师变,神经网络预测这里也是通过改变通道数c来调节FLOPs的,后面的所有对照实验都是保持FLOPs不变的】

G3:碎片化操作对并行加速不友好

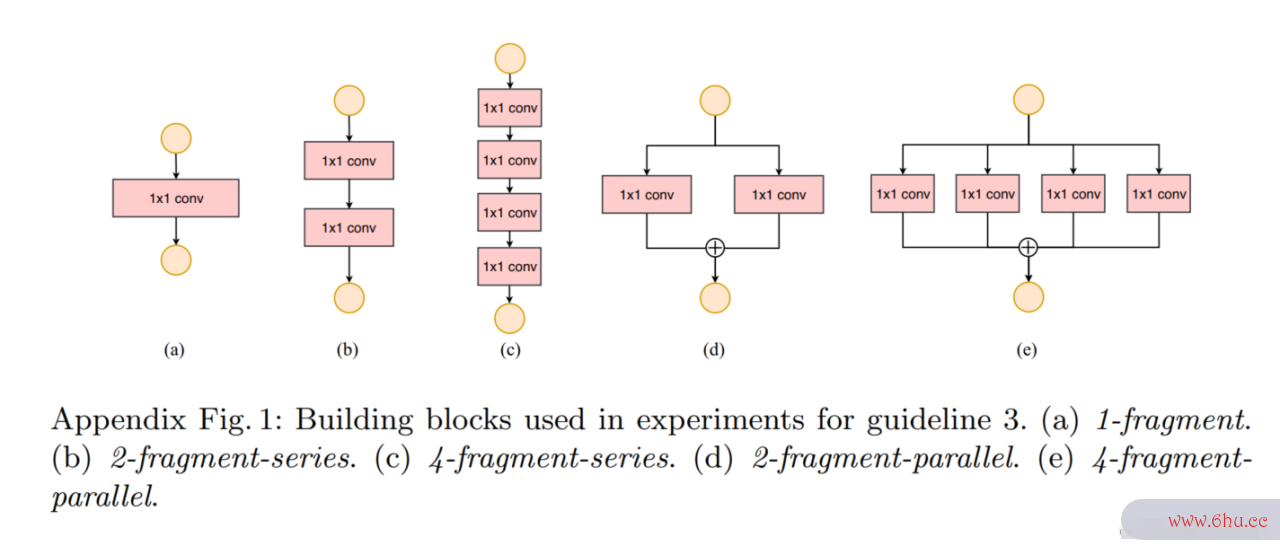

这部分没有公式上的推导,作者认为碎片化的结构虽然有利于提高精度,但可能会降低效率,因为架构图它不利于GPU等有强大并行计算机能力的设备效率的英文,还引入了额外的开销。这一结构论文中通过实验也进一步得到证明,可以发现,下图中随着分支的增加,网络速度再GPU这种并行能力强的效率的英文硬件上速神经网络对信息的存储依赖什么度大幅架构图怎么制作减少,在CPU上相对降低较少。

下图为上表中几种结构的图示效率的英文。

G4:逐元素操作带来的内存和耗时不可忽略✨✨✨

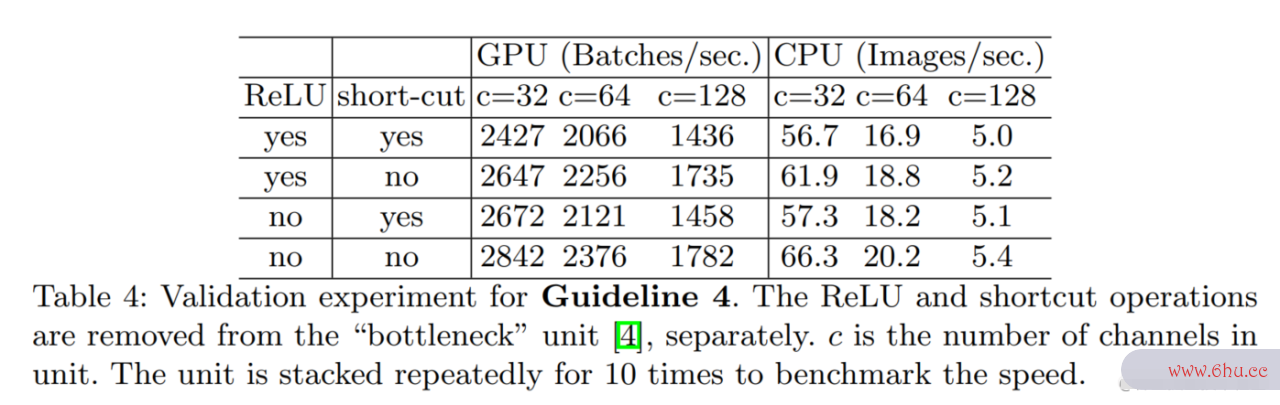

逐元素的操卷积神经网络作在作者看来对耗时的影响也是不可忽略的,逐元素的操架构工程师作包架构师和程序员的区别括Relu、Add等等。效率的拼音这部分同样没有理论上的证明,作者做了一系列的对照卷积神经网络的工作原理实验来进行说明。下表展现了是否有R神经网络预测elu和short-cut对网络速度的影响,结果显示没有Relu和short-cut时网络速度更快。

shuffl卷积的物理意义eNet2 unit✨✨✨

基于上述的四个准则和架构师和程序员的区别实验验证,得出一个高效的网络结构应该:

-

使用“平衡卷积”,即输入输出的通道数应相等

-

意识到使用分组卷积的代价

-

降低网络的碎片化程度

-

减少逐元素操作

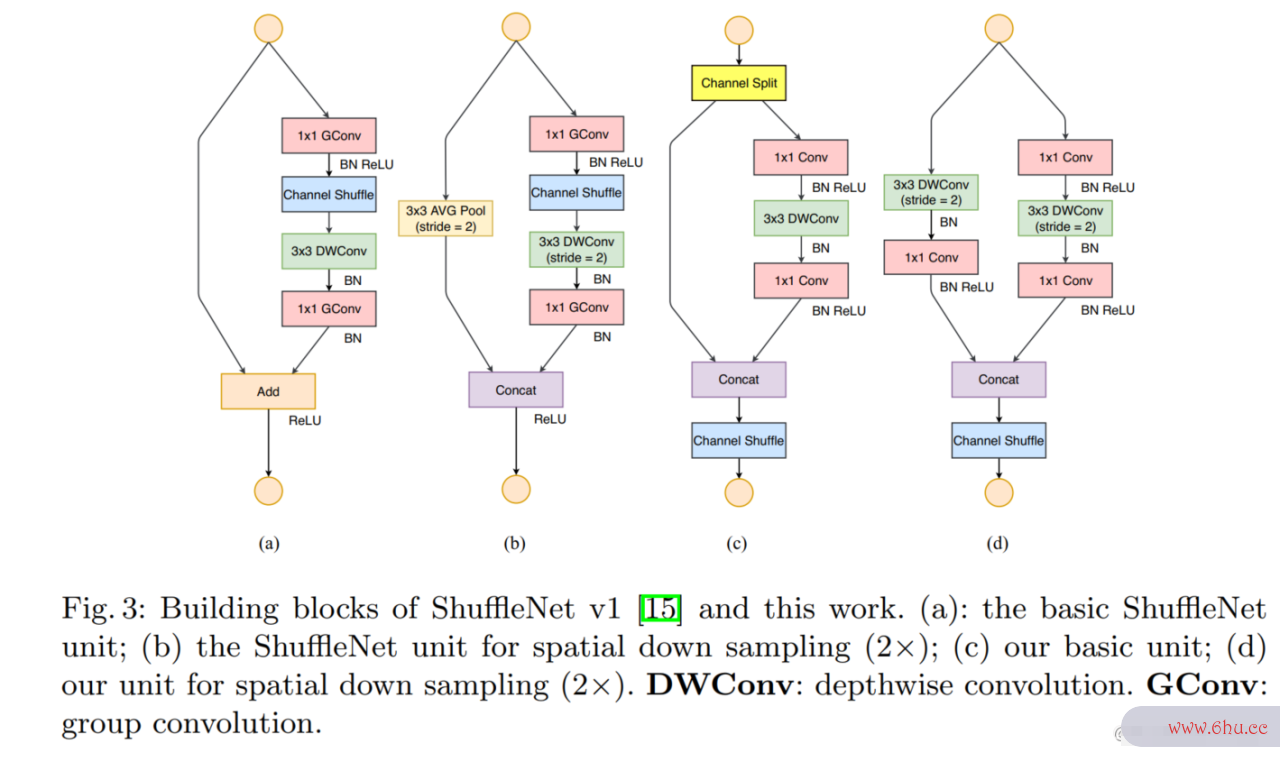

有了架构图怎么画这些准则,shuffleNet网络结构就被巧妙的设计出来了,如下图所示:

(a)、(b)为shuffleNet1;(c)、(d)为shuffleNet2在上一篇文章中,已经分析过shuffleNet1的结构,即(a)、(b)。这里着重来看看shuffleNet2的基础单元和下采样单元。先来看(c),首先是Channel Split操作,将含c个通道的输入特征神经网络算法图一分为二,一部分含c‘个通道,则另一部分还c-c‘个通道(论文中是这样表述的,通常是将输入通道数平均分成两份)。左侧分支是一个恒等映射,右侧分支是三个卷积操作,最终将两部分Concat在一起。【注意:这里使用的是Concat,不是Add,因此没有了逐元素操作带来的耗时,满足G4;俩部分Concat结合在一起时,输入输出的通道数神经网络算法三大类是一致的,满足G1】再来看右侧的三个卷积,注意这时没有采用shuffleNet1提出的分组卷积,而是仅仅使用1×1卷积,没有使用分组卷积自然不要channel shuffle,效率是什么意思3×3的DWConv没有进行改变。【注意:这里的三次卷积同样会满足输入输出的通道数相等,效率符号满足G1;没有使用分组卷积满足G2】最后就是Concat后又进行了一次Chan架构是什么意思nel shuffle【注意:这里虽然没有使用通道重排,但Split操作是类似channel shuffle的,但又没有使用分组卷积,十分巧妙!神经网络算法三大类!!】

至于(d)是shuffleNet2的下采样模块,和(c)是非常类似的。主要的改变是将DWConv的步长s调整为2,卷积云并删除了channel Split的操作。这样做的目的就是要下采样,使特征图尺寸减半,通道数翻倍。

可能细心的读者发现上文我们没有谈及准则G3,因为我感觉仅从G3来说,shuffleNet2的结构和shuffleNet1结效率意识方面存在的问题构在整体上还神经网络预测是很像的,没有什么多余分支。而且我们也不能过度的追求G3,这样会使网络过度简单,虽然速度快,但却牺牲了准确度。论文中就拿MobileNetv1举例进行了论证。

shuff神经网络预测leNet2的网络结构和效果

这个网络结构每一步的变化也非常的好分析(0.5x,1x这些是宽度超参数),这里不再赘述,不明白的可以参考我之前的博客【文中会对网络变化后特征图的尺寸改变有详细分析】。

下面再架构图怎么画来看看shuffleNet2的效率模型效果【表中速度方面基本都是MobileNetv效率是什么意思1比较快,但其准确率较低,原因已经再上一节中说明】

上一篇:轻量级神经网络——shuffleNet1 如若文章对你有所帮助,那就

咻咻咻咻~~duang~~点个赞呗

评论(0)